Количество видеодипфейков в Интернете в 2023 г. увеличилось в три раза по сравнению с предыдущим годом. Аудиодипфейков, по данным Reuters, стало больше в восемь раз. При этом даже профессионалы не способны отличить 25–27% подмененных аудиофайлов. Пока политики и звезды кино борются с дипфейками в социальных сетях, бизнес сталкивается с серьезными угрозами.

Проблемой для биометрических сервисов становятся спуфинговые атаки с виртуальной подменой видео. Сценарии могут быть разными:

- использование сгенерированных видео- и аудиофайлов для доступа к системам;

- применение методов социальной инженерии с имитацией официального лица компании, от которого сотрудникам поступает «задача»;

- использование реальных биометрических данных третьих лиц без их ведома.

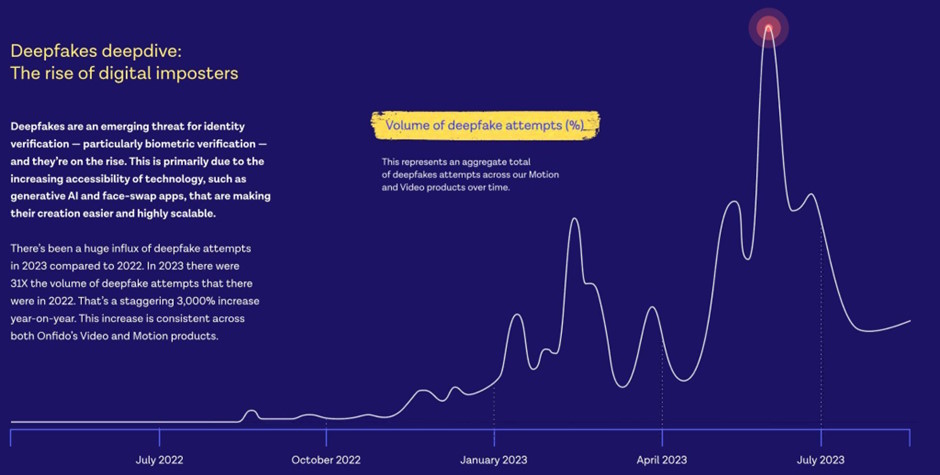

В 2023 году рост цифровых атак с использованием дипфейков составил 3000%, по данным исследования Onfido. Эксперты уверены, что их число будет только увеличиваться.

С проблемой поиска инструментов борьбы с deepfake могут столкнуться:

- p2p-сервисы;

- поставщики финансовых услуг;

- предприятия сферы транспорта и логистики;

- ритейл и розничные сети;

- сервисы каршеринга, а также многие другие.

Что такое дипфейк

Дипфейк — это поддельное видеоизображение или аудио, которые задействуют для дезинформации и манипуляции. Термин происходит от английского «deepfake». «Deep» переводится как «глубокий», «fake» — «обман, подделка, подлог». В России его иногда пишут раздельно «дип фейк», но это неправильно.

В случае с системами идентификации подделку чаще всего применяют в формате видео, но могут использоваться форматы аудио, текста и комбинированные варианты.

Способы создания дипфейков с применением видео:

- Face swapping (замена лица) — подстановка в кадр лица человека, который изначально не участвовал в съемке. Грубая подделка представляет собой простое наложение чужой маски на лица героев исходного видеоряда. Более сложными и опасными считаются современные технологии дипфейков, использующие технологии искусственного интеллекта для детального преобразования внешности.

- Face reenactment (реконструкция) — искусственное изменение выражения лица. Альтернативное название — Lip-sync videos. Исходное лицо сохраняется, но голос, интонации и даже слова (речь) мошенники подделывают.

- Synthetic faces (синтез) — создание идентичностей, которых не существует в реальности.

Методы разработки дипфейков в аудиоформате:

- генерация искусственных аудиоданных с использованием технологии преобразования текста в речь (TTS);

- изменение существующих аудиоданных.

Текстовые дипфейки могут создаваться на основе OpenAI ChatGPT, DeepMind Sparrow, GopherCite и других нейросетей. Злоумышленники могут использовать для атак два и более варианта: комбинации аудио-, видео- и текстовых дипфейков.

Как мошенники используют deepfake

Основные цели атак с применением дипфейков:

- дистанционная идентификация по видео — например, для открытия счета в банке;

- голосовая аутентификация — для одобрения транзакций;

- дистанционная аттестация — в промышленной и транспортной безопасности, для медицинских и педагогических работников, иных лиц;

- удаленное подтверждение личности — при приеме на работу, аренде и т.д.

Злоумышленники могут использовать различные форматы физических атак представления:

- подмена изображений (Printed attack);

- использование масок (Mask attack, включая 3D);

- предоставление заранее записанного видео (Replay attack), в том числе и с использованием метода Camera injection.

| Тип дип фейка | На основе каких данных можно создавать | Технологии и инструменты |

|---|---|---|

| Видео | Создаются на основе видеозаписей с конкретным человеком, на которых нейросетевые модели проходят обучение (английский, русский и другие языки). | FaceSwap.dev, DeepFaceLab, DeepFaceLive, FSGAN, FaceShifter, SimSwap, FaceForensics++. Мобильные приложения Reface, FaceApp или Avatarify. |

| Аудио | Используется голос целевого говорящего. Существуют решения oneshot, которым нужно буквально несколько секунд аудиозаписи. | Фреймворки и библиотеки, в которых реализованы TTS и VC. Eleven Labs, Play.ht, Amazon Polly, FakeYou, CloudTTS, Speechify. |

| Текст | Обучаются на материалах Reddit, Wikipedia и других источников. | ChatGPT-4, LlaMA 2, Claude2 и другие. |

Как обнаружить дипфейки?

Авторы доклада ETSI GR SAI 011 предлагают решать проблему комплексно. Они считают, что необходимо правовое регулирование на законодательном уровне, обучение и повышение осведомленности сотрудников компаний о рисках столкнуться с дипфейком, внедрение технических методов обнаружения. Поскольку сами технологии дипфейков постоянно совершенствуются, методы защиты также должны эволюционировать.

Сейчас используются следующие методы обнаружения:

- Использовать Fraud-detecting AI. Системы на основе искусственного интеллекта тренируются на датасетах и выявляют deepfakes.

- Подключать Liveness (живость, витальность). Решения, которые проверяют «живость» в активном и пассивном режимах, затрудняют подделку данных и загрузку предварительно сгенерированных файлов вместо потоковой трансляции.

- Использовать SDKs вместо APIs. В Software Development Kit включены инструменты «live capture», которые затрудняют использование файлов с цифровыми изменениями.

- Подключать многофакторную авторизацию. Например, использование биометрических данных в связке с паролями и кодами позволяет удостовериться, что в системе настоящий пользователь.

- Внедрять проверку с разных устройств. Кроссплатформенность снижает риск загрузки дипфейков.

Ключевые тенденции мошенничества (по версии Onfido). Согласно исследованию “Identity Fraud Report”, можно выделить следующие тренды:

- Атаки совершают небольшие группы злоумышленников. Мошенник предоставляет десятки и сотни поддельных данных, из-за чего создается ложное ощущение массовости.

- Злоумышленники используют десктопные программы и онлайн-решения для создания дипфейков (как платные, так и бесплатные).

- Преступники фокусируются на одном бизнесе (или одной группе целей) в единицу времени.

Как IDX защищает от дипфейков при идентификации клиентов

Для защиты от дипфейков у IDX предусмотрен модуль «Определение живости» (Liveness Detection). Он состоит из нескольких процессов, с помощью которых можно обнаружить подделку:

- пассивный Liveness — работают алгоритмы, обнаруживающие признаки неживого изображения (артефакты, искажения, несоответствие реакции);

- активный Liveness — система идентификации просит пользователя совершить простые действия (приблизить камеру, отдалить или повернуть ее, назвать цифры, улыбнуться);

Liveness Detection оснащен модулем защиты от дипфейков для снижения риска атак с подменой видео. Система не позволит потенциальному мошеннику использовать предварительно записанные файлы. Дополнительно с помощью модуля можно сохранить видеосессию пользователя и архивировать для изучения в будущем.

Оценить, как системы IDX противостоят дипфейкам, можно в разделе «Подтверждение личности» после регистрации.